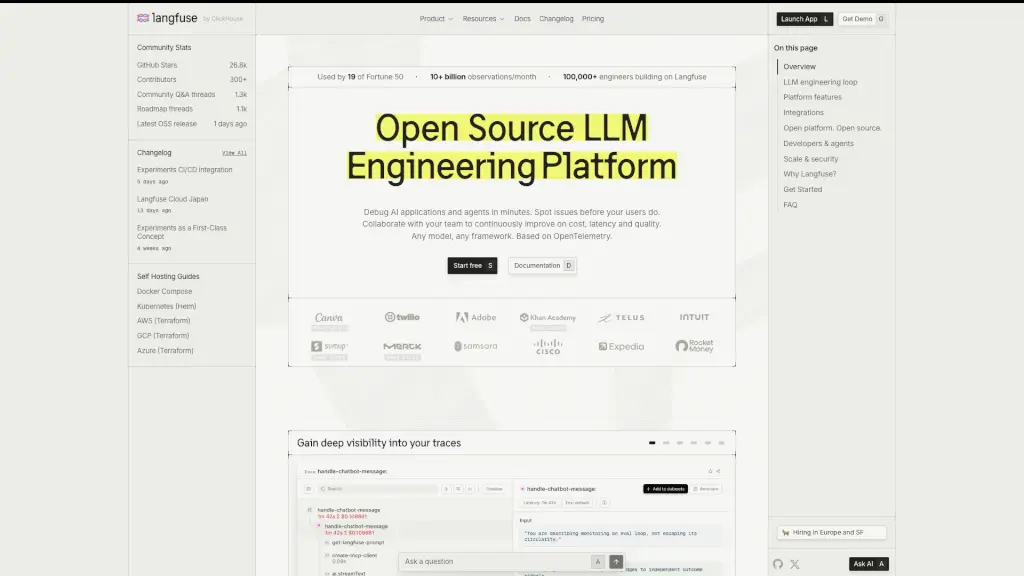

O que é Langfuse?

Langfuse é uma plataforma open-source criada para ajudar equipes a construir, observar e melhorar aplicações com modelos de linguagem grandes (LLMs). Se você está desenvolvendo agentes de IA, chatbots ou qualquer sistema baseado em LLM, o Langfuse oferece ferramentas integradas para rastrear chamadas, gerenciar prompts, avaliar resultados e otimizar desempenho — tudo em um único lugar.

Com suporte nativo ao OpenTelemetry, integração com mais de 80 frameworks (como LangChain, LlamaIndex, Vercel AI SDK) e compatibilidade com todos os principais provedores de modelos (OpenAI, Anthropic, Google Gemini, Amazon Bedrock etc.), o Langfuse elimina o bloqueio tecnológico e permite que você mantenha controle total sobre seus dados, mesmo em escala empresarial.

Quais são as características de Langfuse?

- Observabilidade com Traces Hierárquicos: Captura cada etapa de sua aplicação LLM — desde chamadas ao modelo até execuções de ferramentas e buscas em RAG — com filtros por usuário, sessão, custo, latência ou metadados personalizados.

- Gestão de Prompts Centralizada: Separe prompts do código, faça implantações com um clique, reverta versões facilmente e transforme a melhoria de prompts em um esforço colaborativo da equipe.

- Avaliações Automáticas e Humanas: Use "LLM como juiz", funções heurísticas ou revisões humanas para avaliar saídas automaticamente, tanto em produção quanto em experimentos controlados.

- Experimentos Estruturados: Defina casos de teste, compare modelos ou versões de prompts lado a lado e tome decisões baseadas em dados reais.

- Monitoramento de Custo e Latência: Acompanhe métricas críticas com dashboards e alertas automatizados para garantir eficiência operacional.

- Playground Integrado: Teste prompts com entradas reais de produção e compare o desempenho de diferentes modelos sem sair da plataforma.

- Anotação Humana Colaborativa: Crie conjuntos de dados dourados com revisões em equipe para treinar e validar seus sistemas de IA.

Quais são os casos de uso de Langfuse?

- Depurar falhas em agentes de IA em produção antes que os usuários percebam.

- Comparar o impacto de duas versões de um prompt no custo, latência e qualidade das respostas.

- Validar se uma nova funcionalidade de geração de conteúdo atende aos critérios de segurança e precisão.

- Reduzir custos identificando chamadas redundantes ou ineficientes a modelos caros.

- Treinar modelos de avaliação usando feedback humano coletado diretamente das interações reais dos usuários.

- Garantir conformidade regulatória (como GDPR ou HIPAA) com rastreamento completo e auditável de todas as interações com LLMs.

- Acelerar o ciclo de desenvolvimento de protótipo para produção com experimentos contínuos baseados em dados reais.

Como usar Langfuse?

- Instale o SDK do Langfuse (Python ou TypeScript) ou use instrumentação OpenTelemetry existente.

- Adicione tracing às suas chamadas de LLM com apenas algumas linhas de código — não há bloqueio na execução da sua aplicação.

- Migre seus prompts do código para a interface web do Langfuse para facilitar edições e testes.

- Configure avaliadores automáticos (como exatidão factual ou tom de voz) ou crie fluxos de revisão humana.

- Use o Playground para testar novos prompts com dados reais antes de implantá-los.

- Monitore dashboards de custo, latência e qualidade para detectar regressões rapidamente.