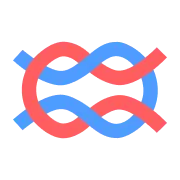

Was ist Langfuse?

Langfuse ist eine Open-Source-Plattform für LLM-Engineering, mit der Teams ihre KI-Anwendungen von der ersten Idee bis zum produktiven Einsatz beobachten, testen und verbessern können. Ob du einen einfachen Chatbot oder komplexe KI-Agenten baust – Langfuse hilft dir, Probleme früh zu erkennen, Kosten im Blick zu behalten und die Qualität deiner Prompts kontinuierlich zu steigern.

Besonders praktisch: Langfuse funktioniert mit nahezu jedem Framework (wie LangChain, LlamaIndex oder Vercel AI SDK) und jedem Modellanbieter (OpenAI, Anthropic, Mistral, Google Gemini und mehr). Dank nativer OpenTelemetry-Unterstützung lässt sich die Plattform nahtlos in bestehende Systeme integrieren – ohne Vendor-Lock-in und mit vollem Zugriff auf deine Daten.

Was sind die Merkmale von Langfuse?

- LLM-Observability: Erfasse hierarchische Traces aller LLM-Aufrufe, Tool-Nutzungen und Retrieval-Schritte – inklusive Filtern nach Benutzer, Kosten, Latenz oder eigenen Metadaten.

- Prompt-Management: Trenne Prompts sauber vom Code, führe One-Click-Deployments durch und ermögliche dem Team, gemeinsam an Prompt-Verbesserungen zu arbeiten.

- Automatisierte Evaluation: Nutze „LLM-as-a-Judge“, Heuristiken oder menschliche Bewertungen, um Ausgaben automatisch zu bewerten – direkt in Produktion oder während Experimenten.

- Experimente & A/B-Tests: Definiere Testfälle, vergleiche Prompt-Versionen oder Modelle side-by-side und triff datenbasierte Entscheidungen.

- Human-in-the-Loop: Führe kollaborative Reviews durch, erstelle „Golden Datasets“ und nutze echtes Nutzungsfeedback zur Weiterentwicklung.

- Kosten- & Latenz-Monitoring: Verfolge Ausgaben, Antwortzeiten und Qualität über Dashboards und erhalte automatische Alerts bei Abweichungen.

Was sind die Anwendungsfälle von Langfuse?

- Debugging von fehlerhaften KI-Agenten in der Produktion, bevor Nutzer davon betroffen sind

- Vergleich verschiedener Prompt-Versionen oder Modelle zur Optimierung der Antwortqualität

- Kontinuierliche Überwachung der Kosten pro Nutzerinteraktion in einem skalierenden SaaS-Produkt

- Aufbau eines internen Evaluations-Workflows mit automatischen Tests und manuellen Reviews

- Migration bestehender Hardcoded-Prompts in ein zentrales, versioniertes Prompt-Management-System

- Integration von Observability in bestehende LangChain- oder LlamaIndex-basierte RAG-Anwendungen

Wie benutzt man Langfuse?

- Installiere das Langfuse SDK (Python oder TypeScript) oder nutze native OpenTelemetry-Instrumentierung

- Konfiguriere deine API-Keys und verbinde dein LLM-Framework (z. B. LangChain) mit nur wenigen Codezeilen

- Starte mit dem „Get Started with Tracing“-Guide, um deinen ersten Trace innerhalb von 5 Minuten zu erfassen

- Nutze das Langfuse Playground, um Prompts anhand echter Produktionsdaten zu testen und zu vergleichen

- Richte erste automatische Evaluatoren (z. B. für Faktentreue oder Toxizität) über die Weboberfläche ein

- Für Agenten-Entwickler: Installiere den Langfuse MCP-Server oder die CLI, um Prompts und Traces per Natural Language zu verwalten