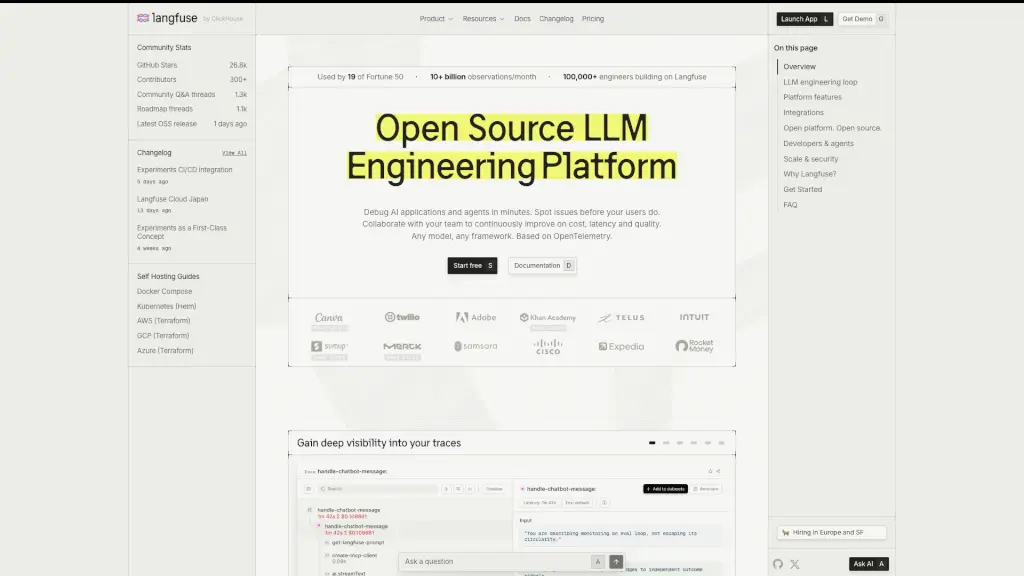

什麼是Langfuse?

Langfuse 是一個開源的 LLM 工程平台,專為開發者打造,幫助團隊從原型階段一路到大規模生產環境,輕鬆建構、監控並持續優化 AI 應用與智能代理(agents)。它整合了追蹤(tracing)、提示管理(prompt management)、自動評估(evaluations)與實驗功能,讓你能快速發現問題、降低錯誤率,並提升模型回應的品質、速度與成本效益。

無論你使用 OpenAI、Anthropic、Google Gemini 還是開源模型,Langfuse 都能無縫支援。基於 OpenTelemetry 標準,它不綁定任何框架,且提供超過 80 種整合選項,包括 LangChain、LlamaIndex、Vercel AI SDK 等熱門工具,讓你自由選擇技術棧,同時享有企業級的可擴展性與資料掌控權。

Langfuse的特色是什麼?

- LLM 追蹤(Tracing):自動記錄每次 LLM 呼叫、工具調用與檢索步驟,形成階層式追蹤,方便除錯與分析。

- 提示管理(Prompt Management):將提示從程式碼中分離,支援一鍵部署、版本回滾與團隊協作優化。

- 自動評估(Evaluations):結合 LLM-as-a-judge、自訂啟發式規則或人工審核,自動評分模型輸出品質。

- 實驗框架(Experiments):建立測試案例,平行比較不同提示或模型的效果,數據驅動決策。

- 人類標註(Human Annotation):團隊可協同審查追蹤紀錄,建立黃金資料集以訓練更精準的評估器。

- 成本與延遲監控:即時追蹤每次呼叫的成本、延遲與品質,並設定警示確保效能達標。

- 開放平台與開源:MIT 授權,支援自行託管(Docker、Kubernetes、AWS/GCP/Azure),資料完全歸你所有。

Langfuse的使用案例有哪些?

- 快速除錯生成式 AI 功能(如 Canva 的設計建議系統),在用戶發現問題前修復異常。

- 團隊協作優化客服聊天機器人的提示詞,透過 A/B 測試找出最高轉換率版本。

- 監控生產環境中 LLM 代理的成本暴增或延遲飆升,設定自動警報避免預算超支。

- 利用真實用戶互動資料建立評估流程,持續提升 RAG 系統的回答準確度。

- 讓編碼代理(如 Cursor、Claude Code)透過 Langfuse CLI 或 MCP 伺服器自動管理提示與追蹤。

- 在 CI/CD 流程中整合自動評估,確保每次程式碼更新不會降低 AI 功能品質。

如何使用Langfuse?

- 安裝 Langfuse SDK(Python 或 TypeScript),只需幾行程式碼即可開始記錄第一筆追蹤。

- 將現有提示遷移至 Langfuse 提示管理介面,實現版本控制與遠端配置。

- 設定自動評估器(例如使用 Ragas 評估 RAG 回答),對生產資料持續打分。

- 使用 Langfuse Playground,在真實用戶輸入上測試新提示,並與現有版本並排比較。

- 建立實驗專案,針對不同用戶群組測試多種模型或提示策略。

- 啟用人類審核工作流,讓團隊成員標記高品質或錯誤回應,累積訓練資料。