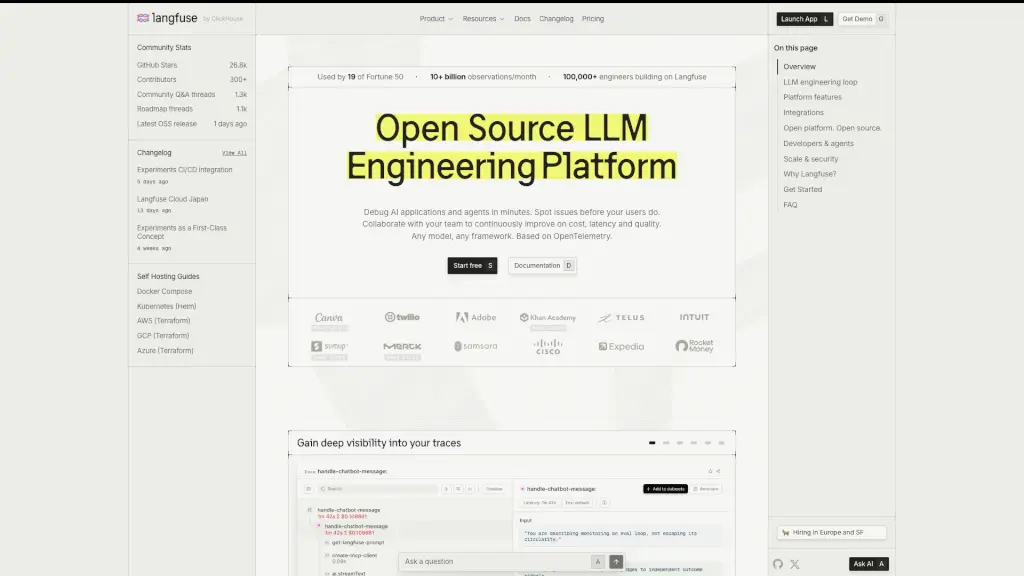

¿Qué es Langfuse?

Langfuse es una plataforma de código abierto diseñada para ayudar a desarrolladores y equipos de ingeniería a construir, observar y mejorar aplicaciones basadas en modelos de lenguaje grandes (LLM). Ya sea que estés creando un prototipo o gestionando una aplicación en producción con millones de usuarios, Langfuse te permite rastrear cada llamada a un modelo, gestionar prompts, evaluar resultados y experimentar con cambios — todo en un solo lugar.

Con soporte nativo para OpenTelemetry, integraciones con más de 80 frameworks (como LangChain, LlamaIndex o Vercel AI SDK) y compatibilidad con proveedores como OpenAI, Anthropic o Google Gemini, Langfuse se adapta a tu stack sin imponer bloqueos tecnológicos. Además, puedes usarla en la nube (incluyendo la nueva región de Langfuse Cloud Japan) o autohospedarla gratuitamente gracias a su licencia MIT.

¿Cuáles son las características de Langfuse?

- Observabilidad de trazas: Captura jerárquicamente cada paso de tus aplicaciones LLM: llamadas al modelo, herramientas, búsquedas RAG y más, con filtros por usuario, latencia, costo o metadatos personalizados.

- Gestión de prompts: Separa los prompts del código, despliega versiones con un clic y revierte fácilmente si algo falla. Ideal para colaborar en equipo.

- Evaluaciones automáticas: Usa "LLM-as-a-judge", funciones heurísticas o revisiones humanas para medir la calidad de las salidas, tanto en producción como en experimentos.

- Experimentos estructurados: Define casos de prueba, compara modelos o versiones de prompts lado a lado y toma decisiones basadas en datos reales.

- Anotación humana colaborativa: Crea flujos de revisión en equipo para construir conjuntos de datos dorados y mejorar continuamente tus modelos.

- Monitoreo de coste y latencia: Dashboard interactivos y alertas automáticas para controlar el rendimiento, gasto y calidad de tus aplicaciones LLM.

- Integración con agentes de código: Herramientas como Claude Code, Cursor o el CLI de Langfuse permiten gestionar trazas, prompts y evaluaciones mediante comandos naturales.

¿Cuáles son los casos de uso de Langfuse?

- Depurar rápidamente fallos en un agente de IA en producción antes de que los usuarios lo noten.

- Comparar el rendimiento de dos versiones de un prompt para elegir la que genere respuestas más precisas.

- Monitorear el costo mensual de llamadas a modelos de OpenAI o Anthropic y optimizar su uso.

- Crear un conjunto de evaluación humano validado para entrenar o afinar un modelo RAG interno.

- Autohospedar Langfuse en AWS o GCP con Terraform para cumplir con requisitos de soberanía de datos.

- Integrar trazas automáticamente en una aplicación LangChain sin modificar el flujo principal del código.

- Usar el Playground de Langfuse para probar prompts con entradas reales de producción antes de lanzar cambios.

¿Cómo usar Langfuse?

- Instala el SDK de Langfuse (Python o TypeScript) y configura tu clave pública y secreta en minutos.

- Envuelve tus llamadas a LLMs con

observe()o usa decoradores para capturar trazas automáticamente. - Mueve tus prompts desde el código a la interfaz web de Langfuse para gestionar versiones y colaborar.

- Configura evaluadores automáticos (como exactitud o relevancia) usando reglas o modelos juez.

- Usa el CLI o la habilidad de agente (

github.com/langfuse/skills) para gestionar Langfuse desde tu IDE. - Explora tus trazas en el panel, filtra por sesión o usuario y detecta patrones de errores o alto costo.