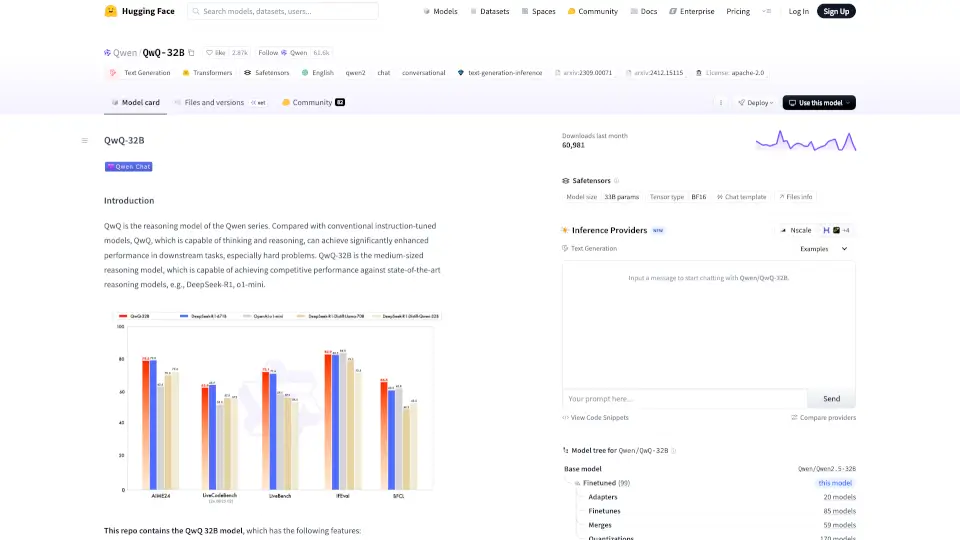

Was ist QwQ-32B?

Qwen/QwQ-32B ist ein leistungsstarkes KI-Modell, das speziell für Textgenerierung und konversationelle Anwendungen entwickelt wurde. Es bietet eine verbesserte Leistung bei komplexen Aufgaben und ist ideal für Benutzer, die auf der Suche nach einem fortschrittlichen KI-Tool sind.

Was sind die Merkmale von QwQ-32B?

- Typ: Kausale Sprachmodelle

- Anzahl der Parameter: 32,5 Milliarden

- Architektur: Transformer mit RoPE, SwiGLU und RMSNorm

- Kontextlänge: Bis zu 131.072 Tokens

- Training: Vortraining und nachfolgendes Training (überwachtes Feintuning und Reinforcement Learning)

Was sind die Anwendungsfälle von QwQ-32B?

- Textgenerierung: Erstellen von kreativen Inhalten und Geschichten.

- Konversation: Interaktive Chats und Kundenservice-Anwendungen.

- Mathematikprobleme: Schritt-für-Schritt-Lösungen für komplexe Aufgaben.

- Multiple-Choice-Fragen: Standardisierte Antworten für Prüfungen und Umfragen.

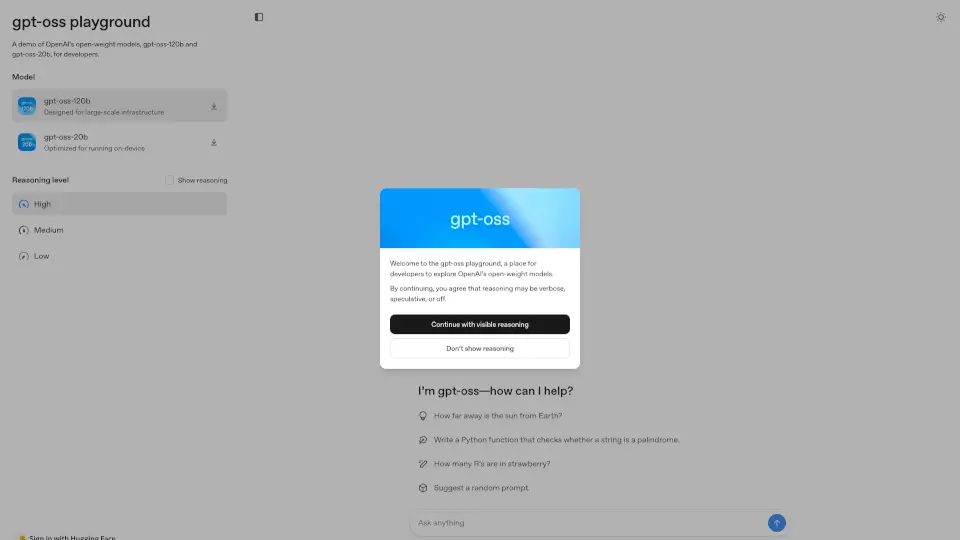

Wie benutzt man QwQ-32B?

Um das Modell zu verwenden, laden Sie den Tokenizer und das Modell mit den folgenden Zeilen:

from transformers import AutoModelForCausalLM, AutoTokenizer

model_name = "Qwen/QwQ-32B"

model = AutoModelForCausalLM.from_pretrained(model_name, torch_dtype="auto", device_map="auto")

tokenizer = AutoTokenizer.from_pretrained(model_name)

Verwenden Sie dann den Tokenizer, um Eingaben zu verarbeiten und das Modell zur Generierung von Text zu verwenden.