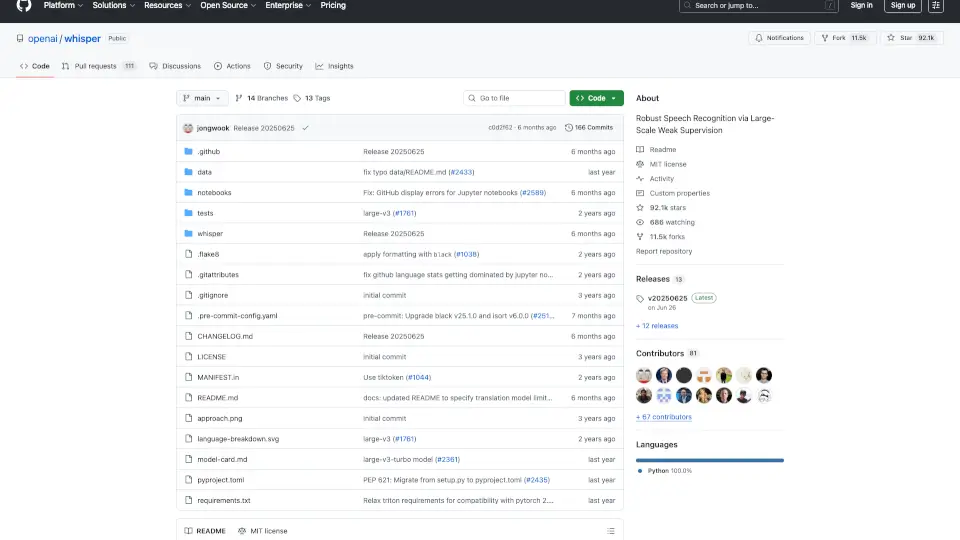

Whisperとは何ですか?

Whisperは、OpenAIが開発した、高性能な音声認識モデルです。多様なオーディオデータでトレーニングされたこのモデルは、多言語音声認識、スピーチ翻訳、言語識別など、さまざまなタスクを実行できます。トラディショナルなスピーチ処理パイプラインの多くの段階を一つのモデルで代替することができます。

Whisperの特徴は何ですか?

- 多言語対応: 英語をはじめ、多くの言語をサポートします。

- 高精度: 大規模なデータセットでトレーニングされたモデルです。

- マルチタスク: 音声認識、翻訳、言語識別が可能です。

- さまざまなモデルサイズ: 小型モデルから大型モデルまで、さまざまなニーズに応えるサイズを用意しています。

- Turboモード: 高速なトランスクリプションを実現します。

- 簡単なセットアップ: FFmpegをインストールするだけで、すぐに使用できます。

Whisperの使用例は何ですか?

- 講演や会議のトランスクリプション: 音声データをテキストに変換します。

- カスタマーサービスの分析: オーディオデータを分析して顧客の声や要望を把握します。

- コンテンツ作成: ポッドキャストや動画の字幕作成に役立ちます。

- 言語学習: 外国語音声のトランスクリプションや翻訳を支援します。

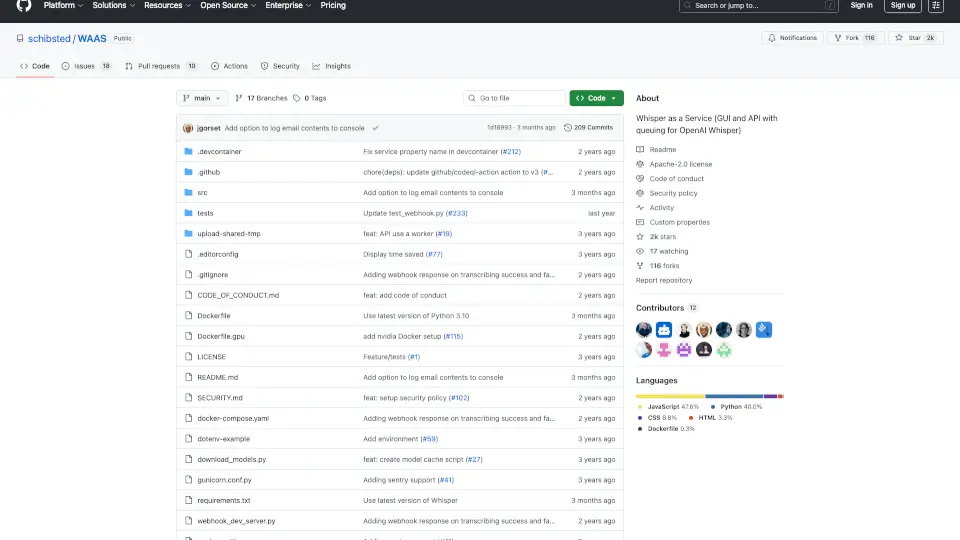

Whisperの使い方は?

- インストール:

pip install -U openai-whisperで最新バージョンをインストールします。- FFmpegをインストールしてください。

- コマンドラインツール:

whisper audio.flac --model turboで音声ファイルをトランスクリプションします。

- Pythonでの使用:

import whisper model = whisper.load_model("turbo") result = model.transcribe("audio.mp3") print(result["text"]) - 言語検出:

detect_language()メソッドで音声の言語を自動検出します。 - 翻訳:

--task translateオプションを追加して音声を翻訳します。