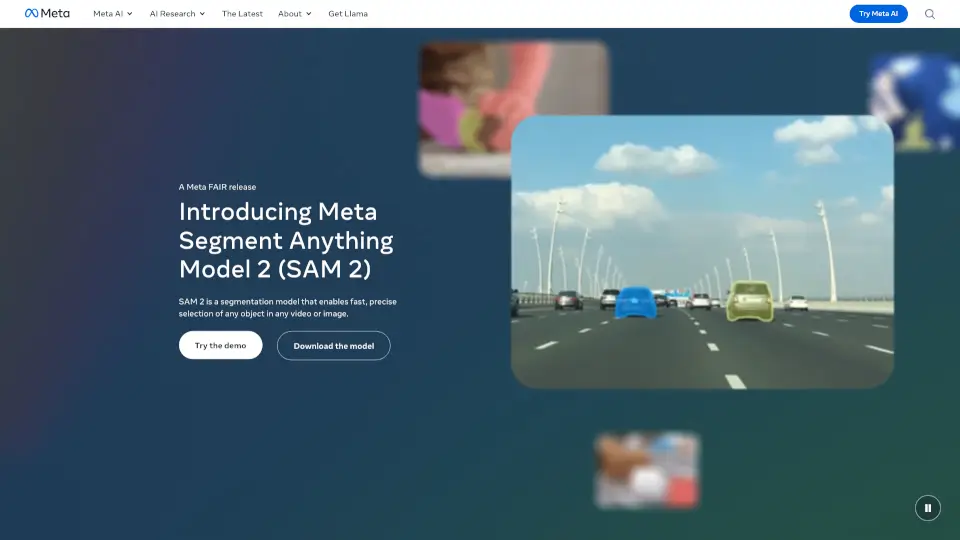

Was ist Meta Segment Anything Model 2?

Meta Segment Anything Model 2 (SAM 2) ist ein leistungsstarkes Segmentierungsmodell, das es ermöglicht, jedes Objekt in Bildern und Videos schnell und präzise auszuwählen. SAM 2 ist das erste einheitliche Modell für die Segmentierung von Objekten in Bildern und Videos und eignet sich für eine Vielzahl von Anwendungen, von der Bildbearbeitung bis hin zur Videoanalyse.

Was sind die Merkmale von Meta Segment Anything Model 2?

- Objektsegmentierung in Echtzeit: SAM 2 ermöglicht die schnelle und genaue Auswahl von Objekten in Bildern und Videos, selbst in Echtzeit.

- Zero-Shot-Fähigkeit: Das Modell kann Objekte segmentieren, die es während des Trainings nicht gesehen hat, was es vielseitig in der Anwendung macht.

- Interaktive Videoverarbeitung: Mit SAM 2 können Objekte in Videos framegenau verfolgt und angepasst werden, selbst wenn sie vorübergehend nicht sichtbar sind.

- Erweiterbare Eingaben und Ausgaben: Das Modell kann mit zusätzlichen Prompts erweitert werden, um kreative Interaktionen zu ermöglichen, und kann als Teil größerer Systeme eingesetzt werden.

Was sind die Anwendungsfälle von Meta Segment Anything Model 2?

- Video- und Bildbearbeitung: Präzise Objekte in Videos und Bildern auswählen und bearbeiten.

- Echtzeit-Anwendungen: Idealer Einsatz in interaktiven Anwendungen, bei denen schnelle Verarbeitung erforderlich ist.

- Künstliche Intelligenz: SAM 2 kann als Teil komplexerer AI-Systeme genutzt werden, um neue Erfahrungen zu ermöglichen.

Wie benutzt man Meta Segment Anything Model 2?

- Objekt auswählen: Klicken, eine Box ziehen oder eine Maske verwenden, um ein Objekt in einem Bild oder Video auszuwählen.

- Anpassungen vornehmen: Verwenden Sie zusätzliche Prompts, um die Vorhersagen des Modells zu verfeinern.

- Über Videos streamen: SAM 2 verarbeitet Video frames nacheinander, was eine effiziente und interaktive Bearbeitung ermöglicht.